Blokowanie plików za pomocą pliku robots.txt

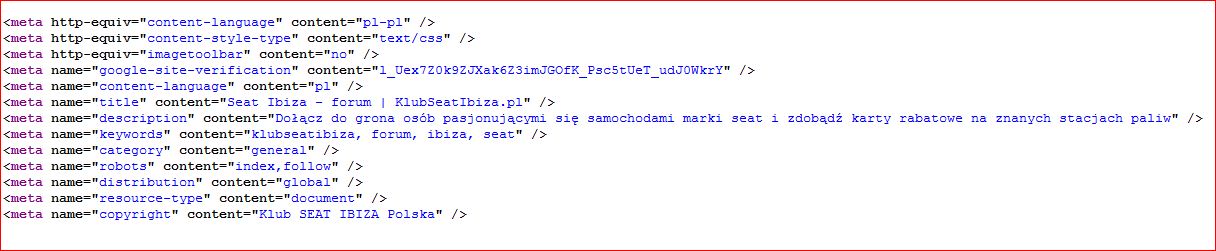

Często przypadłością witryn internetowych w narzędziach dla webmastera udostępnianych przez firmę Google jest problem z podwójnymi tagami tytułowymi. Ponieważ nasza witryna jest dostępna pod dwoma postaciami linków należy zablokować możliwość przeglądania robotom tych zbędnych powtarzających się stron docelowych pod różnymi postaciami adresów URL. Do tego celu można wykrzysać plik robots.txt zamieszczająć odpowiednie polecenia:

User-agent: *

Disallow: /forum/viewtopic.php

Disallow: /forum/viewforum.php

Disallow: /forum/index.php?

Disallow: /forum/posting.php

Disallow: /forum/search.php?

Disallow: /forum/ucp.php

Disallow: /forum/mcp.php

Disallow: /forum/topic

Disallow: /forum/post

Disallow: /forum/member

Disallow: /forum/memberlist.php

Disallow: /forum/faq.php